Algorithmus-Kontrolle – Das Endgame

Teil 1 lesen Sie bitte hier:

Wie Brüssel die freie Rede weltweit unterdrückt

Teil 2 lesen Sie bitte hier:

Die Verbrechen – Was konkret getan wurde

Teil 3 lesen Sie bitte hier:

Democracy Shield im Detail

Teil 4 lesen Sie bitte hier:

TikTok & Meta Policy-Änderungen

Teil 5 lesen Sie bitte hier:

Breton vs. Musk – Der Showdown

Teil 6 lesen Sie bitte hier:

Die transatlantische Zensur-Allianz

Teil 7 lesen Sie bitte hier:

Deutschlands Sonderrolle – Das Zensur-Zentrum Europas

von Michael Hollister

Exklusive Veröffentlichung nur bei Michael Hollister am 20.02.2026

2.495 Wörter * 13 Minuten Lesezeit

Diese Analyse ist frei zugänglich – aber gute Recherchen kosten Zeit, Geld, Energie und Nerven. Unterstützen Sie mich, damit diese Arbeit weitergehen kann.

Oder unterstützen Sie mich auf Substack – schon ab 5 USD pro Monat.

Gemeinsam bauen wir eine Gegenöffentlichkeit auf.

Totale Informationskontrolle

Was kommt, wenn es niemand aufhält

„Control of recommender systems“

Das Eingeständnis. Die unsichtbare Zensur. Das perfekte autoritäre System. Und warum Widerstand noch möglich ist.

„We Have Control“ – Die Maske fällt

8. März 2024. Brüssel.

Ein öffentliches Event: „Protecting The 2024 Elections: From Alarm to Action.“

Organisiert von der EU-Kommission. Anwesend: Vertreter von Meta, Google, TikTok, X. Plus EU-Beamte. Plus „Experten“ von Think Tanks.

Auf der Bühne: Renate Nikolay, Deputy Director-General bei DG-Connect – eine der mächtigsten Technokraten in Brüssel.

Nikolay spricht über den Digital Services Act. Über „systemische Risiken“. Über die „Erfolge“ der letzten Jahre.

Dann sagt sie etwas, das normalerweise nie öffentlich gesagt wird.

Ein Satz, der in einem internen Google-Memo dokumentiert wurde (dem US-Repräsentantenhaus vorgelegt):

„We have control of recommender systems… [but that’s] not enough… we need to go further.“

Lesen Sie das nochmal.

„We have control of recommender systems.“

Nicht „Wir regulieren“. Nicht „Wir überwachen“. „We have control.“

Kontrolle.

Sie sagte es. Öffentlich. Vor Zeugen. Und niemand widersprach.

Weil es die Wahrheit ist.

Die EU-Kommission kontrolliert, was 450 Millionen Europäer auf Social Media sehen.

Nicht direkt. Nicht offensichtlich. Aber strukturell, systematisch, total.

Wie?

Durch Kontrolle der Algorithmen – der unsichtbaren Mechanismen, die bestimmen, was in Ihrem Newsfeed erscheint, was Ihnen empfohlen wird, was Sie sehen.

Das ist das Endgame.

Nicht Bücher verbrennen. Nicht Dissidenten verhaften. Nicht Zeitungen schließen.

Sondern: Informationen unsichtbar machen.

Sie existieren noch. Technisch. Aber niemand sieht sie. Weil der Algorithmus sie versteckt.

Das ist die perfekte Zensur des 21. Jahrhunderts.

Und Sie haben in den letzten sieben Teilen dieser Serie gesehen, wie sie aufgebaut wurde:

- Teil 1: Das System – DSA, Codes, NGOs, Beweise

- Teil 2: Die Verbrechen – Rumänien, COVID, acht Wahlen

- Teil 3: Democracy Shield – User Verification ab 2027

- Teil 4: TikTok/Meta Policies – konkrete Zensur-Regeln

- Teil 5: Breton vs. Musk – der gescheiterte Einschüchterungsversuch

- Teil 6: Stanford – die transatlantische Allianz

- Teil 7: Deutschland – €1,5 Mrd, NetzDG, Correctiv

Jetzt, Teil 8: Wie alles zusammenkommt. Was das Endgame ist. Und ob Widerstand noch möglich ist.

Wie Algorithmen Meinungen formen

Was ist ein Recommender System?

Ein Recommender System (Empfehlungs-Algorithmus) ist der Code, der entscheidet:

- Was erscheint in Ihrem Facebook-Newsfeed?

- Welche Videos schlägt YouTube vor?

- Welche Tweets zeigt X zuerst?

- Was landet auf Ihrer TikTok For You Page?

Sie denken, Sie entscheiden, was Sie sehen?

Falsch.

Der Algorithmus entscheidet.

Beispiel:

Sie folgen auf Facebook 200 Freunden. Aber Facebook zeigt Ihnen nicht chronologisch alle Posts. Stattdessen:

Der Algorithmus berechnet für jeden Post einen Score:

- Wie „relevant“ ist der Post für Sie? (basierend auf Ihrem bisherigen Verhalten)

- Wie „populär“ ist der Post? (Likes, Comments, Shares)

- Wie „sicher“ ist der Post? (Safety Score – ist der Inhalt „problematisch“?)

Nur die Posts mit hohem Score erscheinen in Ihrem Feed.

Der Rest? Unsichtbar.

Sie sehen ihn nie. Sie wissen nicht, dass er existiert.

Wie der Safety Score manipuliert wird

Hier wird es kriminell.

Der Safety Score wird berechnet von KI-Modellen, die trainiert wurden, „problematische Inhalte“ zu erkennen.

Wer definiert „problematisch“?

Die EU-Kommission. Via DSA. Via „Codes of Practice“. Via „Trusted Flaggers“.

Was wird als „problematisch“ markiert?

Wir haben es in Teil 4 gesehen:

- „Marginalizing speech“ (z.B. „Es gibt nur zwei Geschlechter“)

- „Undermines trust in institutions“ (z.B. „Die EU-Kommission ist nicht demokratisch gewählt“)

- „Misinformation“ (z.B. „COVID-Impfstoffe haben Nebenwirkungen“)

- „Hate Speech“ (z.B. „Aggressive Kritik an Politikern“)

Wenn ein Post als „problematisch“ markiert wird:

Sein Safety Score sinkt drastisch.

Sein Gesamt-Score sinkt.

Er erscheint in kaum jemandem’s Feed.

Der Post existiert noch. Technisch. Auf dem Server. Sie können ihn finden, wenn Sie direkt auf das Profil des Posters gehen.

Aber niemand sieht ihn zufällig. Er wird nicht empfohlen. Er taucht nicht in Suchergebnissen auf. Er verschwindet.

Das ist „Demotion“.

Unsichtbare Zensur.

Die Bubble-Kontrolle

Aber es wird noch perfider.

Der Algorithmus formt nicht nur, was Sie sehen. Er formt, wen Sie sehen.

Beispiel:

Sie sind konservativ. Sie liken Posts über Migration, Souveränität, traditionelle Werte.

Der Algorithmus lernt: „Dieser Nutzer ist konservativ.“

Was passiert?

- Konservative Posts von Freunden werden priorisiert in Ihrem Feed

- Linke/progressive Posts von Freunden werden deprioritisiert

Sie denken, Ihre Freunde posten nur konservative Sachen.

In Wirklichkeit posten sie auch anderes – aber der Algorithmus zeigt es Ihnen nicht.

Das Ergebnis:

Sie leben in einer algorithmischen Bubble.

Nicht, weil Sie sich Freunde ausgesucht haben, die alle gleich denken.

Sondern weil der Algorithmus Ihnen nur zeigt, was Ihr Weltbild bestätigt.

Aber – und hier wird es dystopisch:

Die EU-Kommission kann diese Bubble nach Belieben manipulieren.

Beispiel (hypothetisch, aber technisch möglich):

Zwei Wochen vor einer Wahl:

Die EU-Kommission instruiert Platforms: „Priorisiert pro-EU Inhalte. Deprioritisiert EU-skeptische Inhalte.“

Platforms passen die Algorithmen an.

Was passiert?

- Nutzer sehen mehr pro-EU Posts (auch von Freunden, die normalerweise nicht so posten)

- Nutzer sehen weniger EU-kritische Posts (auch von Freunden, die das normalerweise tun)

Die Nutzer merken nichts.

Sie denken: „Interessant, meine Freunde werden plötzlich alle pro-europäischer.“

In Wirklichkeit: Der Algorithmus wurde geändert.

Das ist Meinungsmanipulation auf industrieller Ebene.

Und Nikolay sagte: „We have control.“

Sie log nicht.

Wie weit geht die Kontrolle?

Interne Dokumente (dem US-Committee vorgelegt) zeigen:

Die EU-Kommission hat regelmäßige Meetings mit Platform-Algorithmus-Teams:

Agenda-Punkte (aus Meeting-Protokollen 2023-2024):

- „Wie können Algorithmen ‚positive Narrative‘ priorisieren?“

- „Wie können wir ‚divisive content‘ identifizieren und drosseln?“

- „Welche Metriken nutzen Platforms für ‚civic discourse quality‘?“

„Positive Narrative“ = pro-EU, pro-Regierung, pro-Establishment.

„Divisive content“ = alles, was polarisiert (oft: konservative Meinungen über Migration, Gender, EU).

Die EU-Kommission gibt den Platforms Empfehlungen.

Und Platforms folgen.

Warum?

Weil die Alternative €7 Milliarden Strafe ist.

Die totale Informationskontrolle – Was kommt

Jetzt kombinieren Sie alles, was Sie in dieser Serie gelernt haben:

1. User Verification (ab 2027):

Jeder Nutzer ist identifiziert. Kein anonymer Post mehr.

2. Algorithmus-Kontrolle (jetzt):

Die EU kontrolliert, was Menschen sehen.

3. Trusted Flaggers (270+ NGOs ab 2027):

Hunderte Organisationen mit direkter Zensur-Befugnis.

4. Unified Hate Speech Definition (ab 2027):

„Aggressive Kritik an Politikern“ ist Hate Speech.

5. Pre-Bunking (ab 2026):

Proaktive Propaganda gegen „problematische Narrative“ bevor sie sich verbreiten.

Was bedeutet das zusammen?

Szenario: Deutschland, Bundestagswahl 2029

Januar 2029:

AfD liegt in Umfragen bei 35%. CDU bei 25%. Grüne bei 12%. SPD bei 10%.

AfD könnte stärkste Partei werden.

Das Establishment ist in Panik.

Was passiert:

Phase 1 (Februar 2029): Pre-Bunking

Das European Centre for Democratic Resilience (siehe Teil 3) startet eine €50-Millionen-Kampagne:

- Gesponserte Posts auf Facebook, Instagram, YouTube, TikTok: „Fakten über Extremismus“

- Influencer-Kooperationen: „Warum ich nie AfD wählen würde“

- „Medienkompetenz“-Videos: „So erkennen Sie rechte Desinformation“

Die Kampagne läuft überall. Jeden Tag. Millionen Impressions.

Phase 2 (März 2029): Algorithmus-Manipulation

Platforms passen ihre Algorithmen an:

- AfD-Posts werden um 60% gedrosselt

- Pro-AfD Kommentare werden algorithmisch versteckt

- Anti-AfD Posts werden priorisiert

Nutzer merken nichts. Sie denken einfach: „Komisch, die AfD ist plötzlich weniger präsent.“

Phase 3 (April 2029): Trusted Flagger-Offensive

270 EU-finanzierte Fact-Checker markieren tausende AfD-Posts als:

- „Hate Speech“ (wegen „aggressiver Kritik an Regierung“)

- „Misinformation“ (wegen „irreführender Aussagen über EU-Politik“)

- „Divisive Content“ (wegen „polarisierender Rhetorik“)

Posts werden gelöscht oder mit Warnungen versehen. Reichweite kollabiert.

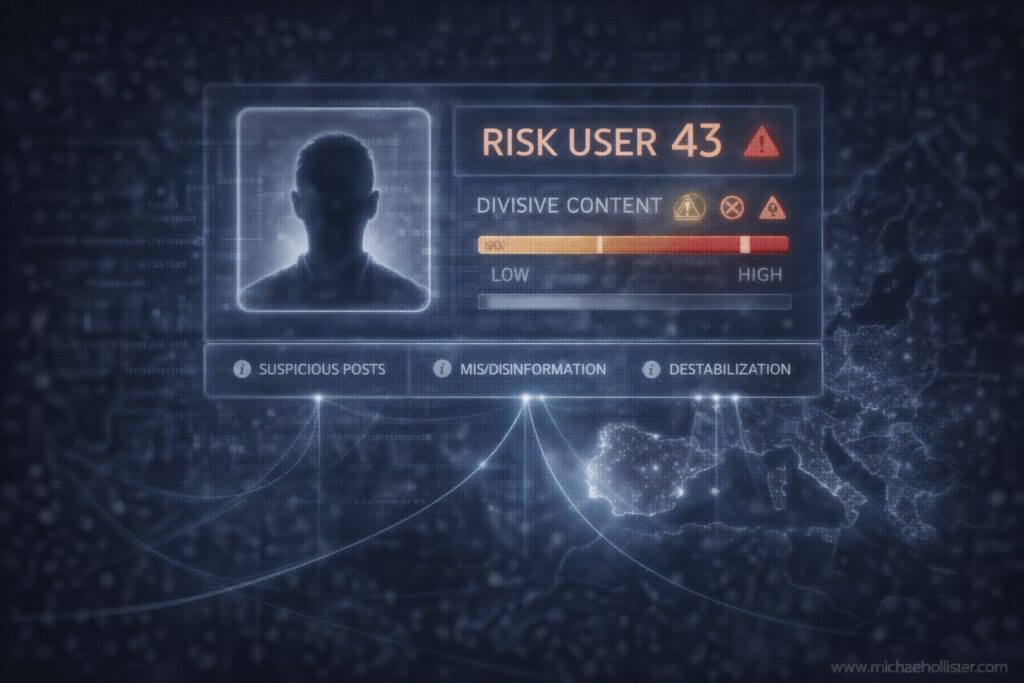

Phase 4 (Mai 2029): User Verification + Social Profiling

Jeder Post ist einem verifizierten Nutzer zugeordnet.

Platforms erstellen Profile:

- Nutzer A: postet häufig AfD-Inhalte — „High Risk User“

- Nutzer B: liked häufig AfD-Posts — „Medium Risk User“

„High Risk Users“ bekommen:

- Alle Posts automatisch gedrosselt (auch unpolitische)

- Shadowban-ähnliche Behandlung

- Möglicherweise Account-Sperrung wegen „wiederholter Verstöße“

Phase 5 (Juni-September 2029): Totale Informationskontrolle

Der durchschnittliche Wähler sieht:

- Viele Anti-AfD Posts

- Wenige Pro-AfD Posts

- Viele Pro-Establishment Posts

Er denkt: „AfD verliert an Unterstützung. Die Umfragen müssen falsch sein.“

In Wirklichkeit: Die Algorithmen wurden manipuliert.

Wahltag (September 2029):

AfD bekommt 28%. Statt 35%.

CDU/SPD/Grüne bilden Koalition.

Mission erfüllt.

Und niemand kann beweisen, dass die Wahl manipuliert wurde.

Weil die Manipulation algorithmisch war. Unsichtbar. Deniable.

Ist das Zukunftsmusik?

Nein.

Das passiert jetzt. Wir haben es in Teil 2 dokumentiert: Acht europäische Wahlen, 2023-2024, dasselbe Muster.

2029 wird es nur perfekter sein.

Weil bis dahin:

- User Verification ist voll implementiert

- Democracy Shield läuft seit drei Jahren

- Algorithmus-Kontrolle ist „normal“ geworden

Social Credit für Europa – Noch nicht offiziell, aber…

China hat ein Social Credit System: Bürger bekommen Punkte. Gutes Verhalten = Punkte steigen. Schlechtes Verhalten = Punkte sinken.

Niedrige Punkte = keine Kredite, keine Flugtickets, keine guten Jobs.

Europa hat offiziell kein Social Credit System.

Aber die Infrastruktur existiert bereits:

- User Verification — Jeder Post ist identifizierbar

- Algorithmus-Profiling — Platforms wissen, wer „problematische“ Inhalte postet

- Trusted Flagger-Reports — NGOs melden „problematische Nutzer“

- DSA-Strafen — Platforms müssen „Wiederholungstäter“ härter bestrafen

Kombiniert:

Ein Nutzer, der regelmäßig „problematische“ Posts macht, bekommt:

- Alle Posts gedrosselt

- Account-Verwarnungen

- Temporäre Sperren

- Permanente Sperrung

Das ist funktional ein Social Credit System.

Nur heißt es nicht so.

Pre-Crime Content Moderation – Die AI sagt vorher

Platforms entwickeln bereits AI-Modelle, die vorhersagen, ob ein Post „problematisch“ werden könnte bevor er sich verbreitet.

Wie es funktioniert:

- AI analysiert einen neuen Post

- AI berechnet: „Wahrscheinlichkeit, dass dieser Post viral geht UND kontrovers wird“

- Wenn Wahrscheinlichkeit hoch: Sofort drosseln (bevor auch nur eine Person ihn sieht)

Das bedeutet:

Zensur bevor Verbreitung.

Nicht reagieren auf „Misinformation“. Sondern präventiv unterdrücken, was potenziell problematisch werden könnte.

Das ist Pre-Crime.

Minority Report für Social Media.

Ist Widerstand möglich?

Die ehrliche Antwort: Ja. Aber schwer.

Technisch: Ja

Tools existieren:

- VPNs – verschleiern Ihren Standort (aber Platforms blockieren VPNs zunehmend)

- Tor Browser – anonymes Surfen (langsam, umständlich)

- Dezentrale Platforms – Mastodon, Nostr, Matrix (kleine Nutzerbasis, aber funktionieren)

- Verschlüsselte Messaging – Signal, Matrix (für private Kommunikation)

Problem:

99% der Menschen bleiben bei Facebook, Instagram, YouTube, TikTok.

Weil dort ihre Freunde sind. Weil es bequem ist. Weil dezentrale Platforms kompliziert sind.

Technischer Widerstand funktioniert nur für eine kleine Elite.

Praktisch: Schwer

Die Realität:

Die meisten Menschen:

- Wissen nicht, wie VPNs funktionieren

- Haben keine Zeit, sich mit Tor zu beschäftigen

- Wollen nicht auf dezentrale Platforms wechseln (weil dort niemand ist)

Das System gewinnt durch Bequemlichkeit.

Menschen wählen Komfort über Freiheit. Immer.

Politisch: Noch möglich – aber das Fenster schließt sich

Was noch möglich ist:

1. Wahlen

Oppositionsparteien wählen, die DSA abschaffen wollen, Democracy Shield stoppen wollen, NGO-Finanzierung beenden wollen.

Problem: Diese Parteien werden systematisch unterdrückt (siehe Teil 2).

2. Klagen

Verfassungsbeschwerden in Deutschland. Klagen vor EGMR (Europäischer Gerichtshof für Menschenrechte).

Problem: Gerichte sind langsam. Urteile kommen Jahre später. Bis dahin ist das System vollständig implementiert.

3. Massenproteste

Millionen auf den Straßen. „Wir wollen Meinungsfreiheit zurück.“

Problem: Massenproteste werden als „rechtsextrem“ geframed (siehe Correctiv, Teil 7). Medien berichten negativ. Öffentliche Meinung wird manipuliert.

4. Technologischer Exodus

Massenhaft zu dezentralen Platforms wechseln. EU-Systeme irrelevant machen.

Problem: Braucht kritische Masse. Solange nur 1% wechseln, ändert sich nichts.

Das Fenster schließt sich:

- 1. Januar 2027: User Verification wird verpflichtend

- Danach: Anonymer Widerstand ist unmöglich

Wir haben zwei Jahre.

Was einzelne tun können

Auch wenn das System übermächtig scheint:

1. Informieren

Teilen Sie diese Serie. Erklären Sie Freunden, Familie, Kollegen, was kommt.

Die meisten Menschen wissen es nicht.

2. Dokumentieren

Wenn Ihre Posts gelöscht werden, zensiert werden, gedrosselt werden: Screenshot. Archivieren. Veröffentlichen.

Machen Sie sichtbar, was unsichtbar gemacht wird.

3. Dezentrale Platforms nutzen

Auch wenn klein: Mastodon, Nostr, Matrix. Je mehr wechseln, desto größer werden sie.

4. VPN nutzen

Nicht perfekt, aber besser als nichts.

5. Spenden

An Organisationen, die für Meinungsfreiheit kämpfen. An alternative Medien. An Anwälte, die gegen DSA klagen.

6. Wählen

Parteien, die dieses System ablehnen. Auch wenn die Wahl manipuliert ist – jede Stimme zählt.

7. Nicht schweigen

Das Wichtigste.

Schweigen ist Zustimmung.

Sprechen Sie aus, was Sie denken. Auch wenn es „problematisch“ ist. Auch wenn Sie gedrosselt werden.

Weil Zensur nur funktioniert, wenn Menschen sich selbst zensieren.

Schlusswort – Die Wahrheit bleibt

Wir sind am Ende dieser Serie angekommen.

Acht Artikel. 20.000+ Wörter. Die umfassendste Dokumentation des EU-Zensur-Systems, die je auf Deutsch geschrieben wurde.

Was Sie gelernt haben:

- Das System: DSA, Codes, NGOs, €3-5 Milliarden, Stanford, Deutschland

- Die Verbrechen: Rumänien, COVID, acht Wahlen, wahre Information zensiert

- Das Endgame: User Verification, Algorithmus-Kontrolle, totale Informationskontrolle

- Die Verantwortlichen: Von der Leyen, Jourova, Breton, DiResta, Kahane, Correctiv

Was jetzt passiert, liegt an Ihnen.

Sie können diese Serie lesen und vergessen.

Oder Sie können handeln.

Aber wissen Sie eines:

Systeme fallen. Immer.

Die Sowjetunion fiel. Das Dritte Reich fiel. Jedes autoritäre System in der Geschichte fiel.

Warum?

Weil Wahrheit stärker ist als Lüge. Langfristig.

Kurzfristig kann Zensur siegen. Kann Propaganda wirken. Können Menschen schweigen.

Aber die Wahrheit bleibt.

Diese Artikel bleiben. Auf Servern. In Archiven. In den Köpfen derer, die sie gelesen haben.

Und wenn das System eines Tages fällt – und es wird fallen –, dann wird es Dokumentation geben.

Beweise, dass es Widerstand gab. Dass nicht alle geschwiegen haben.

Das ist der Wert dieser Serie.

Nicht, dass sie die Welt verändert. Vielleicht tut sie das nicht.

Sondern, dass sie Zeugnis ablegt.

Für die, die nach uns kommen.

Michael’s Geschichte

Der Autor dieser Serie – Michael – ist ein Exildeutscher.

Er diente sechs Jahre in der Bundeswehr. SFOR/KFOR, Balkan-Peacekeeping. Unter Beschuss. Im Kampfgebiet.

Er kämpfte für Deutschland. Für die Werte, von denen sie sagten, sie würden sie verteidigen.

Jahre später verließ er das Land. Weil er sah, wie diese Werte verraten wurden.

Jetzt lebt er in Südamerika. Baut eine Farm auf. Schreibt investigativen Journalismus.

Und kämpft immer noch.

Nicht mit Waffen. Mit Worten. „Die Feder ist mächtiger als das Schwert.“

Das ist Widerstand.

Nicht spektakulär. Nicht heldenhaft im Hollywood-Sinn.

Sondern: Hartnäckig. Ehrlich. Unbequem.

Er hat nicht geschwiegen.

Und Sie?

Ende der Serie

Diese achtteilige investigative Serie dokumentiert das EU-Zensur-System basierend auf dem US-Repräsentantenhaus-Bericht „The Foreign Censorship Threat, Part II“ (3. Februar 2026).

Alle Behauptungen sind durch interne Dokumente, eidesstattliche Aussagen, oder öffentlich zugängliche Quellen belegt.

Teil 1-8 sind verfügbar auf www.michael-hollister.com

Teilen Sie diese Serie.

Verbreiten Sie die Information.

Bei Interesse an einer Zweitveröffentlichung auf Ihrer Webseite kontaktieren Sie bitte gerne den Autor.

Diese Analyse ist frei zugänglich – aber gute Recherchen kosten Zeit, Geld, Energie und Nerven. Unterstützen Sie mich, damit diese Arbeit weitergehen kann.

Oder unterstützen Sie mich auf Substack – schon ab 5 USD pro Monat.

Gemeinsam bauen wir eine Gegenöffentlichkeit auf.

Michael Hollister war sechs Jahre Bundeswehrsoldat (SFOR, KFOR) und blickt hinter die Kulissen militärischer Strategien. Nach 14 Jahren im IT-Security-Bereich analysiert er primärquellenbasiert europäische Militarisierung, westliche Interventionspolitik und geopolitische Machtverschiebungen. Ein Schwerpunkt seiner Arbeit liegt auf dem asiatischen Raum, insbesondere Südostasien, wo er strategische Abhängigkeiten, Einflusszonen und Sicherheitsarchitekturen untersucht. Hollister verbindet operative Innensicht mit kompromissloser Systemkritik – jenseits des Meinungsjournalismus. Seine Arbeiten erscheinen zweisprachig auf www.michael-hollister.com, bei Substack unter https://michaelhollister.substack.comsowie in kritischen Medien im deutsch- und englischsprachigen Raum.

QUELLENLISTE

Öffentlich verfügbar:

- U.S. House Committee Report: https://judiciary.house.gov/sites/evo-subsites/republicans-judiciary.house.gov/files/2026-02/THE-FOREIGN-CENSORSHIP-THREAT-PART-II-2-3-26.pdf

- DSA Text: https://eur-lex.europa.eu/legal-content/EN/TXT/?uri=CELEX:32022R2065

- Democracy Shield Proposal (Nov 12, 2025): https://commission.europa.eu/news-and-media/news/stronger-measures-protect-our-democracy-and-civil-society-2025-11-12_en

- German Federal Budget 2024: https://www.bundeshaushalt.de/

- NetzDG: https://www.gesetze-im-internet.de/netzdg/BJNR335210017.html

- Correctiv Reports: https://correctiv.org/ueber-uns/transparenz/

- Amadeu Antonio Stiftung: https://www.amadeu-antonio-stiftung.de/publikationen/

- Stanford Internet Observatory Publications: https://stacks.stanford.edu/file/druid:tr171zs0069/EIP-Final-Report.pdf

Nicht öffentlich (via US House Report zitiert):

- Internal Platform Documents (subpoenaed): Not publicly available, cited throughout US House Report (key pages for Part 8: pp. 34-35, 70-76, 124-134)

- EU Commission Meeting Minutes (leaked): Not publicly available, cited throughout US House Report (key pages for Part 8: pp. 29-37, 60-70, 96-123)

- Renate Nikolay Statement (March 8, 2024): Not publicly available, documented in internal Google memo cited in US House Report pages 34, 133

© Michael Hollister — Alle Rechte vorbehalten. Die Weitergabe, Veröffentlichung oder Nutzung dieses Textes bedarf der ausdrücklichen schriftlichen Genehmigung des Autors. Bei Interesse an einer Weiterverwendung kontaktieren Sie bitte den Autor über www.michael-hollister.com.

Newsletter

🇩🇪 Deutsch: Verstehen Sie geopolitische Zusammenhänge durch Primärquellen, historische Parallelen und dokumentierte Machtstrukturen. Monatlich, zweisprachig (DE/EN).

🇬🇧 English: Understand geopolitical contexts through primary sources, historical patterns, and documented power structures. Monthly, bilingual (DE/EN).